대학소개

입학·국제교류

대학·대학원

대학생활

산학·연구

취업·창업

정보·민원서비스

| 제목 | 산업공학과/데이터사이언스학과 황상흠 교수 연구팀, ML/AI 분야 Top Conference “ICLR 2026” 논문 발표 | ||||

|---|---|---|---|---|---|

| 작성자 | 홍보실 | 조회수 | 302 | 날짜 | 2026-05-11 |

| 첨부파일 |

|

||||

▲ 왼쪽부터 이의찬 박사과정생, 김정현 석박통합과정생, 지도교수 황상흠

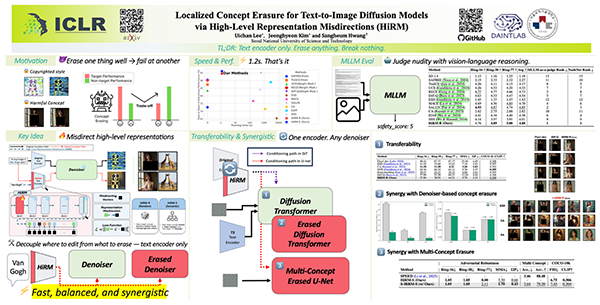

산업공학과/데이터사이언스학과 황상흠 교수 연구팀(이의찬 박사과정, 김정현 석박통합과정)이 기계학습/AI 분야의 국제 저명 학술대회인 International Conference on Learning Representations (ICLR) 2026에서 이미지 생성 모델의 안전성 문제를 다루며, 이를 개선하는 연구를 발표했다. 해당 연구는 텍스트-이미지 변환(T2I) 확산 모델(diffusion model)의 안전한 이미지 생성을 위한 개념 삭제 기술에 주목한다.

강력한 이미지 생성 능력이 유해하거나 사생활을 침해하는 콘텐츠, 또는 저작권 있는 이미지를 합성하는 데 악용될 수 있다는 우려가 커지면서, 이를 방지하기 위한 개념 삭제(concept erasure) 기술이 주목받고 있다. 기존 연구들은 주로 U-Net 같은 denoising 구조를 미세조정하는 방식에 집중해 왔는데, 최근의 인과 추적(causal tracing) 연구에 따르면 시각적 속성 정보가 텍스트 인코더의 초기 self-attention 레이어에 집중되어 있다는 사실이 밝혀졌다.

이 단서를 바탕으로 연구팀이 예비 실험을 진행한 결과, 해당 초기 레이어를 직접 미세조정하면 목표 개념은 억제할 수 있지만 관련 없는 개념들의 생성 품질이 저하되는 문제가 발생했다. 이를 극복하기 위해 연구팀은 HiRM(High-Level Representation Misdirection) 을 제안했다. HiRM은 텍스트 인코더 내에서 목표 개념의 고수준 의미 표현을 랜덤 방향이나 상위 카테고리 같은 의미적 벡터로 유도하는 방식을 사용하면서, 동시에 시각적 속성의 인과 상태가 위치한 초기 레이어만을 선택적으로 업데이트한다.

이러한 분리 전략 덕분에 관련 없는 개념에 미치는 영향을 최소화하면서도 정밀한 개념 제거가 가능하며, 객체/스타일/노출 이미지 등 다양한 삭제 대상에 걸쳐 UnlearnCanvas 및 NSFW 벤치마크에서 우수한 성능을 입증했다. 또한 낮은 학습 비용으로 생성 품질을 유지하고, Flux 같은 최신 아키텍처에 추가 학습 없이 전이가 가능하며, 더 나아가 기존 denoising backbone 기반 삭제 기법과 상호보완적으로 결합될 경우, 생성 유틸리티 손실을 최소화하면서도 보다 강건한 안전성 강화를 달성할 수 있음을 확인하였다. 이는 제안하는 방법론이 효과적인 safety patch로 기능할 수 있음을 보여준다.

본 연구는 개념 삭제 기법의 적용 범위를 확장하고, 이미지 생성 모델의 안전성을 보다 효율적으로 강화하는 후속 연구를 촉진할 것으로 기대된다.

논문정보

• 학회명: International Conference on Learning Representations (ICLR) 2026

• 논문 제목: Localized Concept Erasure in Text-to-Image Diffusion Models via High-Level Representation Misdirection

• 저자: UIchan Lee*, Jeonghyeon Kim*, Sangheum Hwang (*equal contribution)

|

|||||