대학소개

입학·국제교류

대학·대학원

대학생활

산학·연구

취업·창업

정보·민원서비스

| 제목 | 산업공학과/데이터사이언스학과 황상흠 교수 연구팀, AI/CV 분야 Top Conference “CVPR 2025” 논문 2편 발표 | ||||

|---|---|---|---|---|---|

| 작성자 | 홍보실 | 조회수 | 14682 | 날짜 | 2025-06-17 |

| 첨부파일 |

|

||||

|

산업공학과/데이터사이언스학과 황상흠 교수 연구팀이 인공지능/컴퓨터비전 분야의 국제 저명 학술대회인 Computer Vision and Pattern Recognition (CVPR) 2025에서 1) 대규모 시각-언어 모델 (VLM) 의 학습 외 분포 (Out-of-Distribution, OoD) 입력 탐지 방법(김정현 석박통합과정), 2) 이미지 생성 모델의 개인화 (Personalization) 을 위한 학습 방법에 관한 연구(LG CNS) 로 2편의 연구를 발표했다.

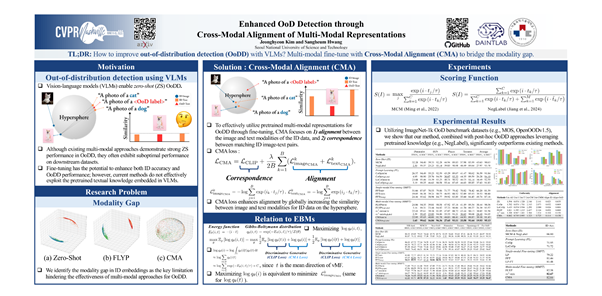

1) 대규모 시각-언어 모델 (VLM) 의 학습 외 분포 (Out-of-Distribution, OoD) 입력 탐지 방법

● 논문 제목: Enhanced OoD Detection through Cross-Modal Alignment of Multi-Modal Representations

● 저자: Jeonghyeon Kim, Sangheum Hwang

본 연구는 대규모 시각-언어 모델 (VLM) 의 학습 외 분포 (Out-of-Distribution, OoD) 데이터 탐지 성능을 개선하는 새로운 방법론을 제시한다. 기존의 OoD 탐지 연구는 주로 단일 모달리티에 집중되어 왔으며, 최근 CLIP과 같은 멀티모달 모델을 활용하는 방법들이 등장했으나, 사전 학습된 모델의 능력을 부분적으로만 활용하는 한계가 있었다. 연구팀은 이러한 한계가 모달리티 갭(modality gap) 현상, 즉 이미지와 텍스트 임베딩이 분리되는 것이 원인임을 실증적으로 분석했다.

이를 해결하기 위해 연구팀은 교차 모달 정렬(Cross-Modal Alignment, CMA)이라는 새로운 학습 목표를 제안했다. CMA는 학습 데이터의 이미지와 텍스트 임베딩 간의 거리를 조절하여 두 모달리티를 고차원 공간상에서 가깝게 정렬시킨다. 이 방법을 통해 모델의 신뢰성과 직결되는 OoD 탐지 성능과 분포 내 데이터 분류 정확도를 모두 크게 향상시켰다.

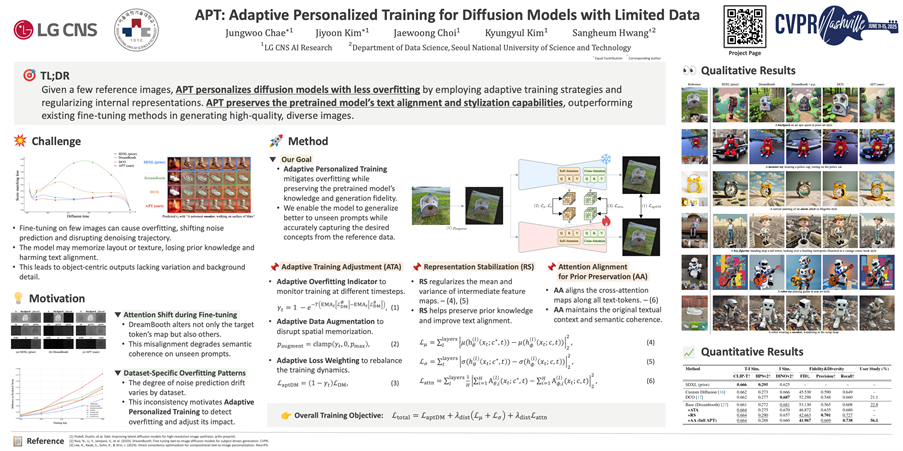

2) 이미지 생성 모델의 개인화 (Personalization) 을 위한 학습 방법

● 논문 제목: APT: Adaptive Personalized Training for Diffusion Models with Limited Data

● 저자: JungWoo Chae, Jiyoon Kim, JaeWoong Choi, Kyungyul Kim, Sangheum Hwang

본 연구는 제한된 참조 이미지로도 고품질 개인 맞춤형 이미지를 생성할 수 있도록 확산 모델을 미세 조정하는 새로운 학습 기법 APT (Adaptive Personalized Training) 를 제안한다. 기존 방법들은 소수의 이미지에 과도하게 적합되면서 사전학습 모델이 갖고 있던 배경 지식과 텍스트 정렬 능력을 잃는 문제를 겪었다.

연구팀은 이러한 과적합 문제의 원인이 확산 단계별로 달라지는 손실의 영향력과 모델 내부 표현의 불안정성에 있다고 분석하고, 이를 해결하기 위해 세 가지 핵심 구성 요소로 이루어진 APT를 설계하였다. 첫째, 확산 단계별 과적합 지표를 도입하고 이에 기반한 데이터 증강 및 손실 가중치 조절을 통해 적응적으로 학습을 조정한다. 둘째, 중간 표현의 통계량(평균, 분산)을 정규화하여 사전학습 모델의 표현 분포를 보존한다. 셋째, 텍스트 의미를 유지하기 위해 교차 어텐션 맵을 정렬하여 사전 지식을 유지한다.

APT는 과적합을 효과적으로 억제하고 사전학습 모델의 스타일과 문맥 이해 능력을 보존하며, 다양한 프롬프트에 대해 더 일관성 있고 풍부한 이미지를 생성하는 데 성공하였다. 정량 평가 및 사용자 연구 결과에서도 기존 방법들을 능가하는 성능을 입증하였다.

|

|||||